RakutenAI-7B: mô hình ngôn ngữ lớn đạt hiệu suất vượt trội cho tiếng Nhật

- RakutenAI-7B là bộ mô hình ngôn ngữ lớn hướng đến tiếng Nhật do các nhà nghiên cứu của Rakuten Group, Inc. phát triển.

- Bộ mô hình bao gồm các mô hình nền tảng, mô hình được tinh chỉnh theo hướng dẫn và trò chuyện, được phát hành theo giấy phép Apache 2.0.

- RakutenAI-7B sử dụng bộ từ vựng mở rộng lên 48.000 token, cải thiện đáng kể khả năng xử lý văn bản tiếng Nhật bằng cách tăng tỷ lệ ký tự trên mỗi token.

- Mô hình được huấn luyện trên bộ dữ liệu khoảng 175 tỷ token, đã được lọc kỹ lưỡng để loại bỏ thông tin cá nhân và dữ liệu chất lượng thấp.

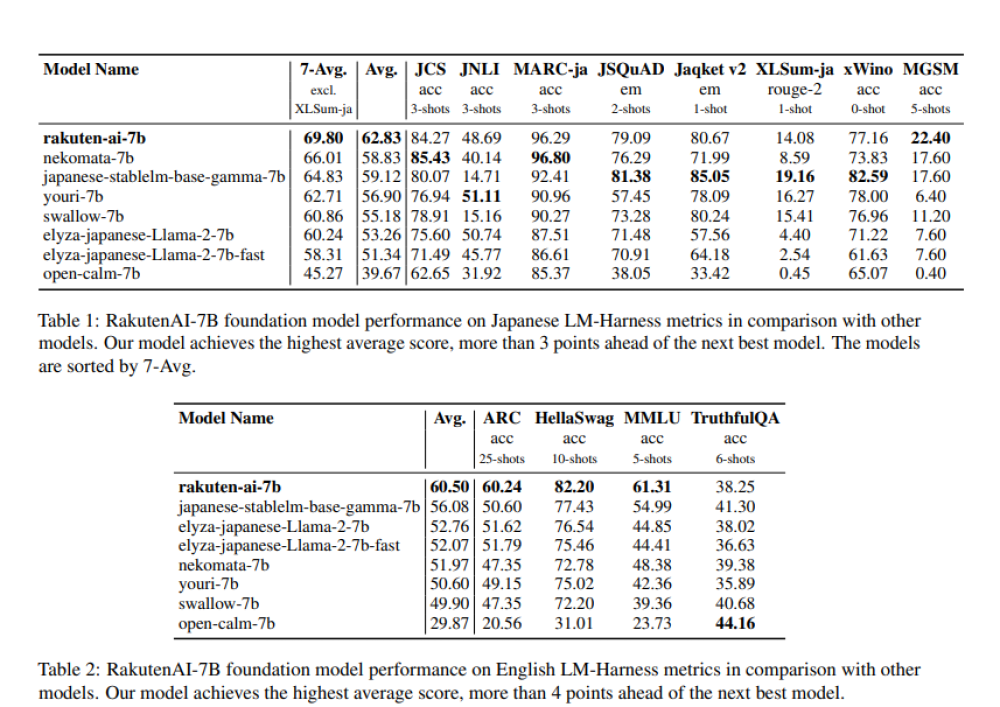

- Các bộ dữ liệu được sử dụng bao gồm XLSUM-ja, MARC-ja, JSQuAD và JAQKET, đánh giá khả năng tóm tắt, phân loại văn bản, trả lời câu hỏi và kiến thức tổng quát.

- RakutenAI-7B vượt trội hơn các mô hình ngôn ngữ lớn khác hướng đến tiếng Nhật trong các đánh giá chuẩn, đạt điểm trung bình 62,83 trên Japanese LM Harness, cao hơn 3 điểm so với đối thủ gần nhất.

- Phiên bản RakutenAI-7B-instruct đạt điểm trung bình 68,74 trên Japanese LM Harness, dẫn đầu gần 2 điểm.

- Mô hình cũng thể hiện hiệu suất tốt trong các tác vụ ngôn ngữ tiếng Anh, cho thấy tính linh hoạt và đa dạng của nó.

📌 RakutenAI-7B đại diện cho bước tiến quan trọng trong việc tạo ra các mô hình ngôn ngữ hiệu quả và bao quát hơn. Với cách tiếp cận hệ thống và bộ dữ liệu chất lượng cao, mô hình liên tục đạt hiệu suất tốt trong nhiều tác vụ xử lý ngôn ngữ tự nhiên, vượt trội hơn các mô hình mở khác cho tiếng Nhật. Bộ tokenizer của nó phù hợp hơn để xử lý văn bản tiếng Nhật, có khả năng dẫn đến quá trình huấn luyện và suy luận nhanh hơn, rẻ hơn.

https://www.marktechpost.com/2024/03/30/rakutenai-7b-a-suite-of-japanese-oriented-large-language-models-that-achieve-the-great-performance-on-the-japanese-language-model/

Thảo luận

Follow Us

Tin phổ biến