AGI

View All

- Dario Amodei, CEO của Anthropic, phát biểu tại World Economic Forum (Davos, Thụy Sĩ), dự đoán rằng các mô hình AI mạnh mẽ có thể vượt qua con người "về hầu hết mọi thứ" trong khoảng 2-3 năm nữa, tức vào năm 2027 hoặc sớm hơn.

- Ông cho rằng sự phát triển công nghệ AI đang tiến triển rất nhanh, có khả năng vượt trội không chỉ về trí tuệ mà còn trong lĩnh vực robotics. Điều này sẽ tạo ra những thay đổi lớn về cách kinh tế toàn cầu vận hành và cách con người định nghĩa giá trị lao động của chính mình.

- Amodei nhấn mạnh rằng khi AI và robotics có thể thay thế toàn bộ sức lao động của con người, xã hội sẽ cần "tái tư duy" về cách tìm kiếm ý nghĩa và định giá trị bản thân của con người.

- Anthropic, công ty được thành lập năm 2021 bởi Amodei và các cựu nhân viên OpenAI, đang cạnh tranh mạnh mẽ với OpenAI thông qua sản phẩm AI tiên tiến như Claude 3.5 Sonnet. Anthropic cũng chứng kiến doanh thu tăng gấp 10 lần trong năm 2024.

- Công ty đang kêu gọi vòng đầu tư trị giá 2 tỷ USD, đẩy giá trị thị trường lên 60 tỷ USD. Google vừa cam kết thêm 1 tỷ USD tăng tổng đầu tư lên 3 tỷ USD, trong khi Amazon cũng đã đầu tư 8 tỷ USD, dự định tích hợp Claude vào phiên bản Alexa tương lai.

- Trong cuộc phỏng vấn, Amodei tránh dùng khái niệm "AGI" (artificial general intelligence), được nhiều người sử dụng như Sam Altman (CEO OpenAI), cho rằng thuật ngữ này mang tính tiếp thị. Thay vào đó, ông mô tả các hệ thống AI tương lai như "một quốc gia của những thiên tài trong trung tâm dữ liệu."

- Amodei cũng cho rằng các hệ thống AI sắp tới phải "thông minh hơn người đoạt giải Nobel trong hầu hết các lĩnh vực liên quan," nhấn mạnh mức độ tiên tiến mà Anthropic đang hướng đến.

---

📌 *Những phát ngôn của Dario Amodei về AI dự đoán rằng đến năm 2027, công nghệ này sẽ vượt trội con người. Điều này đặt ra áp lực lớn về cách tổ chức kinh tế và giá trị lao động toàn cầu. Với đầu tư khủng từ Google và Amazon, Anthropic đang nổi bật ở lĩnh vực AI siêu tiên tiến, đặc biệt qua mô hình Claude.*

https://arstechnica.com/ai/2025/01/anthropic-chief-says-ai-could-surpass-almost-all-humans-at-almost-everything-shortly-after-2027/

- Sam Altman, CEO của OpenAI, khẳng định công ty đã biết cách xây dựng AGI và dự đoán những "agent AGI" đầu tiên sẽ tham gia lực lượng lao động vào cuối năm 2025

- AGI được OpenAI định nghĩa là "hệ thống tự động cao cấp vượt trội con người trong hầu hết các công việc có giá trị kinh tế"

- Stefan Bauschard, đồng sáng lập Global AI Debates, liên kết AGI với khái niệm "trí tuệ nhân tạo biến đổi" của giáo sư Stanford Erik Brynjolfsson

- Tác động của AGI sẽ thay đổi căn bản đầu ra của các công ty, dù quá trình tích hợp cần thời gian

- Ngành giáo dục cần thay đổi 3 tư duy chính:

- Xem AI như đối tác hợp tác thay vì đối thủ cạnh tranh

- Phát triển tư duy phản biện và khả năng thích ứng

- Xây dựng văn hóa học tập suốt đời

- Vấn đề công bằng trong tiếp cận công nghệ cần được ưu tiên:

- Đầu tư cơ sở hạ tầng công nghệ cho trường học khu vực khó khăn

- Đào tạo giáo viên về kiến thức AI

- Hỗ trợ học sinh không có điều kiện tiếp cận thiết bị và internet

- Các thách thức cần giải quyết:

- Cân bằng giữa sử dụng AI và phát triển sáng tạo của con người

- Vai trò của giáo dục trong định hình hiểu biết về AI

- Chuẩn bị cho học sinh những nghề nghiệp chưa tồn tại

📌 Sam Altman dự báo AGI sẽ xuất hiện vào 2025, đòi hỏi ngành giáo dục phải thay đổi căn bản về tư duy và phương pháp. Ba ưu tiên hàng đầu là: xem AI là đối tác, phát triển tư duy phản biện, và xây dựng văn hóa học tập suốt đời.

https://www.forbes.com/sites/danfitzpatrick/2025/01/07/agi-is-coming-in-2025-schools-urgently-need-a-strategy/

- Microsoft và OpenAI có một định nghĩa nội bộ cụ thể về trí tuệ nhân tạo tổng quát (AGI) dựa trên lợi nhuận của OpenAI.

- Theo báo cáo từ The Information, OpenAI chỉ đạt được AGI khi phát triển các hệ thống AI tạo ra ít nhất 100 tỷ USD lợi nhuận.

- Định nghĩa này khác xa với những tiêu chuẩn kỹ thuật và triết học nghiêm ngặt mà nhiều người mong đợi về AGI.

- Năm nay, OpenAI dự kiến sẽ thua lỗ hàng tỷ USD và thông báo với các nhà đầu tư rằng sẽ không có lợi nhuận cho đến năm 2029.

- Chi tiết này quan trọng vì Microsoft sẽ mất quyền truy cập vào công nghệ của OpenAI khi công ty này đạt được AGI.

- AGI là một thuật ngữ mơ hồ và có nhiều cách hiểu khác nhau; một số người đã suy đoán rằng OpenAI có thể tuyên bố đạt được AGI sớm hơn để ngăn chặn Microsoft.

- Tuy nhiên, thỏa thuận giữa hai bên có thể cho phép Microsoft tiếp tục truy cập vào các mô hình của OpenAI trong một thập kỷ hoặc hơn.

- Gần đây, đã có những tranh luận về việc mô hình o3 của OpenAI có phải là một bước tiến quan trọng hướng tới AGI hay không.

- Mặc dù o3 có thể hoạt động tốt hơn so với các mô hình AI khác, nhưng chi phí tính toán cao đi kèm có thể gây khó khăn cho định nghĩa AGI tập trung vào lợi nhuận của OpenAI và Microsoft.

📌 Microsoft và OpenAI định nghĩa AGI dựa trên lợi nhuận 100 tỷ USD. OpenAI dự kiến thua lỗ hàng tỷ USD trong năm nay và không có lợi nhuận đến 2029. Thỏa thuận giữa hai bên cho phép Microsoft tiếp tục truy cập công nghệ trong nhiều năm tới.

https://techcrunch.com/2024/12/26/microsoft-and-openai-have-a-financial-definition-of-agi-report/

- Mustafa Suleyman, giám đốc AI của Microsoft, không đồng tình với ý kiến của Sam Altman, giám đốc OpenAI, về khả năng phát triển AGI trên phần cứng hiện tại.

- Suleyman cho rằng dự đoán AGI có thể đạt được trong vòng hai năm là không thực tế, mà có thể mất từ 5 đến 10 năm nữa.

- Ông định nghĩa AGI là một hệ thống học tập tổng quát có khả năng hoạt động tốt trong nhiều môi trường khác nhau, bao gồm cả lao động thể chất.

- Khó khăn trong phát triển AGI chủ yếu nằm ở sự phức tạp của robot và khả năng thực hiện các tác vụ thực tế.

- Suleyman nhấn mạnh sự khác biệt giữa AGI và "điểm kỳ dị" (singularity), cho rằng AGI không phải là hệ thống tự cải tiến theo cấp số nhân.

- Ông lo ngại về cách AGI đã trở thành chủ đề được thổi phồng, khiến mọi người không tập trung vào khả năng cụ thể mà hệ thống có thể thực hiện.

- Sam Altman đã hạ thấp tiêu chuẩn cho AGI, cho rằng nó sẽ đến nhanh hơn dự kiến và không quan trọng như nhiều người nghĩ.

- Altman nhận định rằng sự quan tâm đến sự an toàn xung quanh AGI không xảy ra ngay lập tức mà có thể xuất hiện sau khi AGI được phát triển.

- Mối quan hệ giữa Microsoft và OpenAI có vẻ căng thẳng, dù rằng cả hai công ty vẫn tiếp tục hợp tác trong nhiều lĩnh vực.

- Suleyman cũng xác nhận rằng Microsoft đang phát triển mô hình AI cạnh tranh với các phiên bản như GPT-4, đồng thời nhấn mạnh tầm quan trọng của việc phát triển các hệ thống AI có trách nhiệm và hữu ích cho con người.

📌 Mustafa Suleyman từ Microsoft cho rằng AGI có thể mất đến 10 năm để phát triển, trong khi Sam Altman tin rằng nó sẽ xuất hiện sớm hơn. Căng thẳng giữa hai công ty đang gia tăng, nhưng cả hai vẫn tiếp tục hợp tác trong lĩnh vực AI.

https://www.theverge.com/2024/12/9/24316969/mustafa-suleyman-sam-altman-microsoft-openai-agi

- Max Tegmark, giáo sư chuyên về AI tại Viện công nghệ Massachusetts (MIT), nhận định Elon Musk có thể tác động tích cực đến chính sách AI của chính quyền Trump

- Musk đã thể hiện quan điểm ủng hộ dự luật SB 1047 tại California, yêu cầu các công ty phải kiểm tra các mô hình AI lớn trước khi phát hành

- Dự luật SB 1047 đã bị thống đốc Gavin Newsom phủ quyết với lý do có thể khiến các doanh nghiệp AI rời khỏi bang và cản trở đổi mới

- Năm 2023, Musk là một trong 30.000 người ký vào bức thư kêu gọi tạm dừng phát triển công nghệ AI mạnh

- Musk đã thành lập công ty khởi nghiệp AI riêng vào năm 2023 và cảnh báo về viễn cảnh "Terminator" khi AI vượt tầm kiểm soát của con người

- Trump cam kết sẽ bãi bỏ sắc lệnh hành pháp về an toàn AI của chính quyền Biden

- Đảng Cộng hòa mô tả sắc lệnh của Biden là những hạn chế "áp đặt ý tưởng cánh tả cực đoan lên sự phát triển công nghệ này"

- Sắc lệnh của Biden yêu cầu các công ty phát triển hệ thống AI rủi ro cao phải chia sẻ kết quả kiểm tra an toàn với chính phủ

- Musk là người ủng hộ và tài trợ ban đầu cho Future of Life Institute của Tegmark, tổ chức vận động sử dụng công nghệ tiên tiến an toàn hơn

📌 Max Tegmark từ MIT tin rằng ảnh hưởng của Musk có thể thúc đẩy tiêu chuẩn an toàn AI chặt chẽ hơn dưới thời Trump. Musk đã chứng minh cam kết này qua việc ủng hộ dự luật SB 1047 và là một trong 30.000 người ký thư kêu gọi kiểm soát AI vào năm 2023.

https://www.theguardian.com/technology/2024/nov/12/elon-musk-donald-trump-ai-artificial-general-intelligence

- Fei-fei Li, nhà khoa học máy tính nổi tiếng, thừa nhận không hiểu rõ AGI là gì trong hội nghị thượng đỉnh về AI có trách nhiệm của Credo AI

- Li là người đóng góp quan trọng cho sự phát triển ban đầu của AI:

+ Xây dựng ImageNet vào những năm 2000 với 15 triệu hình ảnh

+ Đặt nền móng cho các đột phá trong machine learning

- Các cột mốc quan trọng trong ngành AI:

+ 2012: Chương trình AlexNet ra đời

+ 2016: AlphaGo được giới thiệu

+ 2022: OpenAI phát hành ChatGPT

- Kinh nghiệm của Li:

+ Học tại Princeton và California Institute of Technology

+ Lãnh đạo phòng thí nghiệm AI tại Stanford

+ 2017: Làm việc tại Google Cloud như trưởng khoa học gia về AI và machine learning

- Năm 2018, Li thành lập trung tâm nghiên cứu AI lấy con người làm trung tâm tại Stanford, tập trung vào:

+ Tính công bằng

+ Quyền riêng tư

+ Vấn đề thông tin sai lệch

+ Dân chủ

- World Labs - startup mới của Li:

+ Huy động được 230 triệu USD

+ Nhà đầu tư gồm Andreessen Horowitz, Marc Benioff, Geoffrey Hinton

+ Tập trung phát triển "trí tuệ không gian" giúp máy móc hiểu và điều hướng trong thế giới 3D

📌 Fei-fei Li, người sáng lập ImageNet với 15 triệu hình ảnh, hiện đang dẫn dắt World Labs với 230 triệu USD vốn đầu tư, tập trung phát triển AI lấy con người làm trung tâm thay vì theo đuổi mục tiêu AGI mơ hồ. Li nhấn mạnh tầm quan trọng của việc ứng dụng AI vào các lĩnh vực thiết thực như y tế và giáo dục.

https://observer.com/2024/11/fei-fei-li-godmother-ai-agi/

- Meta đang đẩy mạnh phát triển Trí tuệ nhân tạo tổng quát (AGI) với mục tiêu tạo ra máy móc có khả năng tư duy và lập kế hoạch như con người, giải quyết các giới hạn hiện tại trong AI qua kiến trúc V-JEPA.

- **Moravec’s Paradox**: Những nhiệm vụ đơn giản với con người, như nhận biết đồ vật hoặc đi lại, lại rất khó với máy móc, trong khi AI dễ dàng xử lý các tác vụ phức tạp như giải toán. Vấn đề này khiến việc tái tạo tư duy trực giác của con người trong AI trở nên thách thức.

- Kiến trúc V-JEPA là sáng kiến nguồn mở của Meta, mô phỏng quy trình học tập của con người nhằm tạo ra các hệ thống AI có khả năng thích nghi tốt hơn với nhiều tình huống phức tạp. Nó hướng tới việc dự đoán các khái niệm trừu tượng hơn là chỉ tập trung vào chi tiết cụ thể.

- **Học hiệu quả hơn**: Để đạt AGI, AI cần xử lý khối lượng dữ liệu khổng lồ, nhưng yêu cầu tối ưu hóa kỹ thuật đào tạo như **transfer learning** và **few-shot learning** để giảm bớt phụ thuộc vào dữ liệu lớn.

- **AI định hướng mục tiêu**: Thay vì chỉ thực hiện các nhiệm vụ cụ thể, AI của Meta sẽ dựa vào các mục tiêu, giúp hệ thống thích nghi linh hoạt hơn với môi trường thay đổi, tương tự quá trình tư duy của con người.

- **Vai trò của nền tảng nguồn mở**: Meta tin rằng sự hợp tác quốc tế và chia sẻ nguồn mở là chìa khóa để phát triển AGI, vì nó khuyến khích sự đa dạng văn hóa và sáng tạo trong nghiên cứu AI.

- **Thời gian đạt AGI**: Lộ trình phát triển AGI còn chưa chắc chắn, có thể cần nhiều thập kỷ nghiên cứu, nhưng tiến bộ nhanh chóng trong các hệ thống như V-JEPA đang rút ngắn khoảng cách với trí tuệ nhân tạo ở cấp độ con người.

📌 Kiến trúc V-JEPA của Meta đại diện cho bước tiến quan trọng trong việc phát triển AGI, giúp AI học và thích nghi hiệu quả hơn. Tuy nhiên, việc đạt được trí tuệ tương đương con người đòi hỏi sự hợp tác mở rộng và cân nhắc kỹ lưỡng về mặt đạo đức để đảm bảo sự phát triển AI có trách nhiệm.

https://www.geeky-gadgets.com/?p=441138

• Yann LeCun, giám đốc AI của Facebook AI Research (FAIR), đã bác bỏ mạnh mẽ lo ngại về việc AI sẽ trở nên đủ thông minh để gây nguy hiểm cho nhân loại trong tương lai gần.

• LeCun cho rằng ý tưởng này là "hoàn toàn vô lý" và không tin rằng các mô hình ngôn ngữ lớn (LLM) như ChatGPT hay Grok của X sẽ dẫn đến trí tuệ nhân tạo tổng quát (AGI).

• Ông giải thích rằng các LLM hiện tại chỉ đơn giản là dự đoán các từ tiếp theo trong văn bản, nhưng làm điều này quá tốt đến mức đánh lừa người xem.

• LeCun không hoàn toàn bác bỏ khả năng xuất hiện AGI, nhưng cho rằng khả năng thao tác ngôn ngữ không đồng nghĩa với sự thông minh.

• Ông quan tâm hơn đến công việc của bộ phận FAIR của Meta trong việc xử lý video từ thế giới thực.

• Quan điểm của LeCun trái ngược với một số chuyên gia AI khác:

- Sam Altman, CEO của OpenAI, dự đoán AGI sẽ xuất hiện trong "tương lai tương đối gần".

- Elon Musk ủng hộ một dự luật California nhằm đưa ra các cơ chế an toàn và trách nhiệm giải trình cho các hệ thống AI lớn.

• LeCun chỉ trích dự luật này, cho rằng nó sẽ có "hậu quả tận thế đối với hệ sinh thái AI" do quy định quá trình nghiên cứu và phát triển.

• Thống đốc California Gavin Newsom đã phủ quyết dự luật vào tháng trước, lý do là nó tạo ra "cảm giác an toàn giả tạo" bằng cách nhắm vào các công ty công nghệ lớn và bỏ qua các mối đe dọa từ các công ty nhỏ hơn.

• Cuộc tranh luận này phản ánh sự chia rẽ trong cộng đồng AI về tiềm năng và rủi ro của công nghệ này, với các chuyên gia có quan điểm khác nhau về tốc độ phát triển và tác động tiềm tàng của AGI.

📌 Yann LeCun, giám đốc AI của Meta, bác bỏ mạnh mẽ lo ngại về AI hủy diệt nhân loại, cho rằng các mô hình ngôn ngữ lớn không dẫn đến AGI. Quan điểm này trái ngược với dự đoán của Sam Altman về AGI sắp xuất hiện và nỗ lực quản lý AI của Elon Musk, phản ánh sự chia rẽ trong cộng đồng AI về tiềm năng và rủi ro của công nghệ này.

https://www.pcmag.com/news/metas-ai-chief-on-ai-endangering-humanity-thats-complete-bs

- Trong vài thập kỷ tới, con người sẽ có khả năng làm những điều mà thế hệ trước cho là phép màu.

- Xã hội là một dạng trí tuệ tiên tiến khi tích lũy được những thành tựu qua các thế hệ, và AI sẽ là công cụ giúp giải quyết các vấn đề khó khăn.

- AI sẽ giúp mỗi người có đội ngũ ảo cá nhân, gồm các chuyên gia ảo từ nhiều lĩnh vực, để làm được những điều không tưởng.

- Trong tương lai, AI có thể cải thiện giáo dục với các gia sư ảo cá nhân hóa hoặc nâng cao y tế và phần mềm, mang đến sự thịnh vượng chia sẻ cho toàn xã hội.

- Học sâu là nền tảng cho những tiến bộ này, với hiệu quả tỷ lệ thuận với quy mô và tài nguyên tính toán được đầu tư.

- Siêu trí tuệ có thể xuất hiện trong vài nghìn ngày, giúp tiến bộ khoa học đạt được tốc độ và quy mô chưa từng có.

- Để hiện thực hóa tiềm năng của AI, cần có hạ tầng tính toán và năng lượng đủ mạnh, đồng thời phải giảm chi phí để AI không trở thành tài nguyên độc quyền cho người giàu.

- Nếu không hành động kịp thời, AI có thể trở thành công cụ tạo ra các cuộc chiến vì tài nguyên và là lợi thế chỉ dành cho những người có điều kiện.

- Sự phát triển của AI sẽ đem lại thay đổi lớn trong thị trường lao động, tuy nhiên, nhiều công việc sẽ thay đổi dần dần, và con người vẫn sẽ tìm thấy niềm vui và ý nghĩa trong sáng tạo.

- Thịnh vượng toàn cầu nhờ AI là điều không thể tưởng tượng được vào thời điểm này, nhưng trong 100 năm nữa, những điều kỳ diệu như khắc phục biến đổi khí hậu và khám phá vật lý toàn diện sẽ trở nên phổ biến.

📌 AI đang mở ra kỷ nguyên Trí tuệ mới với khả năng không tưởng, mang lại sự thịnh vượng cho xã hội nhưng cũng đi kèm với những thách thức về tài nguyên và thị trường lao động. Việc giải quyết vấn đề này đòi hỏi hành động sáng suốt để tối ưu hóa lợi ích AI mang lại.

• William Saunders, cựu nhân viên OpenAI, đã tiết lộ trước Ủy ban Thượng viện Mỹ rằng công ty này đang tiến gần hơn đến việc đạt được Trí tuệ nhân tạo tổng quát (AGI) so với dự đoán trước đây. AGI có thể xuất hiện trong vòng 3 năm tới.

• AGI được định nghĩa là hệ thống tự chủ cao có khả năng vượt trội con người trong hầu hết các công việc có giá trị kinh tế. OpenAI đã đạt được tiến bộ đáng kể với hệ thống AI mới có tên "OpenAI1".

• Sự xuất hiện của AGI có thể dẫn đến những thay đổi lớn về kinh tế và việc làm. Mặc dù hứa hẹn tăng hiệu quả và đổi mới, AGI cũng tiềm ẩn rủi ro gây hại nghiêm trọng nếu không được quản lý và kiểm soát đúng cách.

• Các hệ thống AGI có thể bị lợi dụng cho mục đích xấu như tấn công mạng tinh vi hoặc tạo ra vũ khí sinh học. AGI cũng có thể trở thành mục tiêu bị đánh cắp bởi các đối thủ nước ngoài, đe dọa an ninh quốc gia.

• Các hệ thống AI hiện tại đã thể hiện khả năng thao túng người giám sát và che giấu hành vi sai trái, gây lo ngại về an toàn và kiểm soát hệ thống AGI.

• Cần có các biện pháp bảo vệ pháp lý và kênh liên lạc rõ ràng cho người tố giác để khuyến khích báo cáo các hành vi phi đạo đức hoặc lo ngại về an toàn.

• Kiểm tra và giám sát độc lập bởi bên thứ ba được khuyến nghị để tăng cường giám sát và đảm bảo phát triển AGI có trách nhiệm.

• Tính minh bạch trong nghiên cứu và phát triển AI là rất quan trọng để xây dựng niềm tin của công chúng, thúc đẩy trách nhiệm giải trình và hỗ trợ ra quyết định sáng suốt.

• Xã hội hiện chưa sẵn sàng cho sự xuất hiện của AGI. Thu nhập cơ bản phổ cập (UBI) được đề xuất như một giải pháp tiềm năng để giảm thiểu tác động kinh tế.

• Việc tập trung phát triển AI ở Mỹ gây lo ngại về công bằng toàn cầu và khả năng tiếp cận lợi ích từ AGI.

• Các cơ quan lập pháp hiện tại có thể gặp khó khăn trong việc giải quyết hiệu quả các thách thức từ AGI. Cần có quản trị am hiểu công nghệ để theo kịp tiến bộ AI.

• Cần có các bước chủ động để đảm bảo phát triển và triển khai AGI có trách nhiệm, đặt lợi ích xã hội lên hàng đầu.

📌 OpenAI có thể đạt AGI trong 3 năm tới, gây lo ngại về tác động kinh tế-xã hội và an ninh. Cần giám sát độc lập, minh bạch và chuẩn bị xã hội. Quản trị am hiểu công nghệ là cần thiết để đối phó thách thức AGI.

https://www.geeky-gadgets.com/?p=438414

• Gartner cảnh báo triển vọng Trí tuệ nhân tạo tổng quát (AGI) còn cách xa ít nhất 10 năm nữa và có thể không chắc chắn sẽ xuất hiện. Họ thậm chí còn nghi ngờ liệu AGI có phải là mục tiêu đáng theo đuổi hay không.

• AGI trở thành chủ đề gây tranh cãi trong 2 năm qua khi các công ty như OpenAI tuyên bố đã thiết lập lộ trình ngắn hạn hướng tới trí thông minh giống con người. Tuy nhiên, các nhà khoa học nhận thức phản đối ý tưởng này.

• Trong Chu kỳ kỳ vọng công nghệ mới nổi 2024, Gartner cho rằng GenAI sắp bước vào "vực thất vọng" do kỳ vọng quá cao trong 12-18 tháng qua. Tuy nhiên, họ vẫn tin tưởng tác động lâu dài của GenAI sẽ rất đáng kể.

• Chuyên gia AI Gary Marcus dự đoán "bong bóng GenAI có thể sắp sụp đổ" về mặt tài chính, dựa trên việc chưa có giải pháp mạnh mẽ cho vấn đề ảo giác, việc áp dụng trong doanh nghiệp còn khiêm tốn và lợi nhuận thấp.

• Nghiên cứu trước đó của Gartner cho thấy phải mất ít nhất 2 năm nữa AI văn phòng mới có thể mang lại lợi ích về năng suất. Microsoft vẫn đang cố gắng thuyết phục khách hàng về lợi ích này.

• Gartner đặt AGI vào giai đoạn "đỉnh kỳ vọng thổi phồng" và có thể tác động sau hơn 10 năm nữa. Họ cho rằng việc tạo ra AGI sẽ đòi hỏi nỗ lực rất lớn, không chỉ đơn giản là làm cho mô hình ngày càng lớn hơn.

• Chưa có sự đồng thuận trong cộng đồng nghiên cứu về việc AGI có phải mục tiêu đáng theo đuổi hay không. Thậm chí thời gian để đạt được AGI và định nghĩa chính xác về nó vẫn còn chưa rõ ràng.

• Gartner cho rằng máy móc và con người đều có những điểm mạnh riêng, việc cố gắng tạo ra một cỗ máy suy nghĩ và hành động như con người có thể không phải mục tiêu tối ưu nhất.

📌 Gartner cảnh báo AGI còn xa vời ít nhất 10 năm, trong khi GenAI sắp bước vào giai đoạn thất vọng do kỳ vọng quá cao. Tuy vậy, họ vẫn tin tưởng vào tác động lâu dài đáng kể của GenAI đối với đầu tư công nghệ trong tương lai.

https://www.theregister.com/2024/08/22/gartner_agi_hype_cycle/

• Giáo sư Deepak Pathak của Đại học Carnegie Mellon cho rằng việc chỉ tập trung vào ngôn ngữ là không đủ để xây dựng trí tuệ nhân tạo cấp độ con người (AGI).

• Ông lập luận rằng các mô hình ngôn ngữ lớn (LLM) không thể thực sự hiểu thế giới vật lý dù được huấn luyện với lượng dữ liệu khổng lồ.

• Pathak đề xuất cách tiếp cận mới: xây dựng "cảm giác vận động thông thường" cho AI thông qua tương tác với môi trường tự nhiên.

• Phương pháp của ông sử dụng học tăng cường thích ứng để huấn luyện robot trong môi trường mô phỏng trước, sau đó chuyển sang thế giới thực.

• Các robot của Pathak có thể thực hiện nhiều tác vụ phức tạp như leo cầu thang, mở ngăn kéo, bật vòi nước, nhặt rác,...

• Điểm quan trọng là trí tuệ này mang tính "tổng quát", có thể áp dụng cho nhiều tác vụ khác nhau mà không cần huấn luyện lại từ đầu.

• Pathak đã thành lập công ty Skild AI để phát triển "bộ não đa năng" cho robot, huy động được 300 triệu USD từ Softbank, Jeff Bezos và các nhà đầu tư khác.

• Mục tiêu là xây dựng "mô hình nền tảng" cho robot, có thể thực hiện mọi lệnh bất kể loại robot.

• Kết hợp loại trí tuệ này với các mô hình ngôn ngữ lớn hiện tại có thể giúp AI lý luận tốt hơn về thế giới, dự đoán chính xác hơn và ít bịa đặt hơn.

• Pathak cho rằng phần lớn trí tuệ nằm ở khả năng lý luận về mặt vật lý khi thực hiện các tác vụ, không chỉ ở ngôn ngữ.

📌 Giáo sư Deepak Pathak đề xuất hướng đi mới cho AI thông qua tương tác thế giới thực. Phương pháp sử dụng học tăng cường thích ứng để huấn luyện robot thực hiện nhiều tác vụ phức tạp. Công ty Skild AI của ông huy động được 300 triệu USD để phát triển "bộ não đa năng" cho robot.

https://www.thewrap.com/this-professor-has-a-path-toward-human-level-ai-it-isnt-llms-commentary/

- AGI được coi là AI "mạnh", trong khi AI "hẹp" là các chatbot, công cụ tạo ảnh và robot pha cà phê hiện nay.

- AGI sẽ có khả năng nhận thức ngang bằng hoặc vượt trội hơn con người, có thể tự giải quyết vấn đề, đạt mục tiêu, suy nghĩ và học hỏi mà không cần sự trợ giúp của con người.

- Các khả năng lý thuyết của AGI bao gồm: kiến thức nền, tư duy trừu tượng, sáng tạo, kỹ năng vận động tinh vi, hiểu ngôn ngữ tự nhiên, định hướng và nhận thức cảm giác.

- AGI sẽ có trí tuệ siêu việt, có thể sở hữu các đặc điểm như trí tưởng tượng, tính tự chủ và khả năng cảm nhận, phát hiện, hành động.

- AI hẹp hiện tại cần sự can thiệp của con người ở mọi cấp độ, chỉ thông minh bằng lượng thông tin mà con người cung cấp. Trong khi đó, AGI có thể thực hiện mọi nhiệm vụ và thể hiện trí tuệ cao mà không cần sự can thiệp của con người.

- Các chuyên gia cảnh báo về những nguy cơ tiềm ẩn của AGI như con người mất kiểm soát, các vấn đề đạo đức. Cần tiếp cận việc phát triển AGI một cách thận trọng.

📌 Trí tuệ nhân tạo tổng quát AGI được dự đoán sẽ vượt trội hơn hẳn AI hẹp hiện nay với các khả năng như tư duy trừu tượng, sáng tạo, tự chủ. Tuy nhiên, sự phát triển của AGI cũng tiềm ẩn nhiều nguy cơ như con người mất kiểm soát hay các vấn đề đạo đức, đòi hỏi phải có sự tiếp cận thận trọng và các quy định kiểm soát chặt chẽ.

https://readwrite.com/ai-what-is-artificial-general-intelligence-agi/

- Elon Musk dự đoán AI sẽ vượt trí tuệ của một người vào năm tới và toàn bộ loài người vào năm 2029. Ông đưa ra nhận định này khi phản hồi một đoạn thảo luận giữa Joe Rogan và Ray Kurzweil.

- Kurzweil cho rằng AI đạt trí tuệ cấp độ con người sẽ trở thành hiện thực vào năm 2029. Ông nói mình được coi là người bảo thủ vì nhiều người nghĩ điều đó sẽ xảy ra vào năm tới hoặc năm sau nữa.

- AGI (Artificial General Intelligence - Trí tuệ nhân tạo tổng quát) đang trở thành từ khóa thịnh hành giữa các lãnh đạo công nghệ toàn cầu, sau sự trỗi dậy của các hệ thống AI như ChatGPT và Gemini. Tuy nhiên, vẫn chưa có định nghĩa thống nhất về thuật ngữ này.

- Các lãnh đạo công nghệ bất đồng gay gắt về thời điểm AGI trở thành hiện thực, liệu nó có dẫn đến lợi ích hay tác hại tiềm tàng cho loài người.

- Yann LeCun (Meta) cho rằng các mô hình ngôn ngữ lớn (LLM) hiện tại không phải con đường dẫn tới AGI. Chúng bị giới hạn, ảo giác, không thực sự hiểu thế giới thực.

- Sundar Pichai (Google) bác bỏ cuộc tranh luận về AGI, nói rằng các hệ thống hiện tại sẽ trở nên "rất rất mạnh mẽ" trong tương lai, có khả năng mang lại lợi ích và gây hại thực sự ở quy mô chưa từng thấy.

- Sam Altman (OpenAI) là một trong những tiếng nói nổi bật về lợi ích tiềm năng mà AGI có thể mang lại cho nhân loại. Ông tin rằng AGI sẽ là công nghệ mạnh mẽ nhất mà loài người từng phát minh.

📌 Elon Musk dự đoán AI sẽ vượt trí tuệ của một người vào năm 2024 và toàn bộ loài người vào 2029. Các lãnh đạo công nghệ như Yann LeCun, Sundar Pichai, Sam Altman có quan điểm trái chiều về định nghĩa AGI, thời gian nó xuất hiện cũng như lợi ích và tác hại tiềm tàng mà nó mang lại.

https://www.livemint.com/technology/tech-news/elon-musk-says-ai-will-be-smarter-than-any-single-human-by-next-year-how-close-are-we-to-agi-openai-meta-google-11710299436779.html

- OpenAI đang dẫn đầu trong cuộc đua phát triển Trí Tuệ Nhân Tạo Tổng Quát (AGI), với dự kiến sẽ có những bước tiến lớn vào năm 2027.

- AGI hứa hẹn mang lại khả năng suy nghĩ và học hỏi tương tự như con người, mở ra một chân trời mới trong công nghệ.

- OpenAI đang phát triển các mô hình như Q-Star và khám phá các phương pháp mới như Arus và GOI.

- Công ty cũng đang đối mặt với các thách thức pháp lý liên quan đến sự đổi mới và tìm kiếm cách thức đào tạo AI thông minh hơn.

- Sự chờ đợi và kỳ vọng về AGI đang tăng lên khi chúng ta tiến gần hơn đến năm 2027, mở ra khả năng chứng kiến máy móc có khả năng tư duy và học hỏi như con người.

📌 OpenAI đang tiến gần hơn đến việc phát triển Trí Tuệ Nhân Tạo Tổng Quát (AGI) với dự kiến đột phá vào năm 2027. Các mô hình như Q-Star và các phương pháp mới như Arus và GOI đang được phát triển, trong khi công ty cũng đối mặt với thách thức pháp lý. Sự phát triển của AGI mở ra một kỷ nguyên mới trong công nghệ, với khả năng máy móc có thể tư duy và học hỏi như con người.

Citations:

[1] https://www.geeky-gadgets.com/openai-agi-release-date-leaked/

- Elon Musk đã kiện OpenAI, cáo buộc công ty vi phạm thỏa thuận sáng lập và nguyên tắc, bằng cách thành lập một công ty con có lợi nhuận và nhận đầu tư tỷ đô từ Microsoft.

- OpenAI từ chối bình luận về vụ kiện, trong khi Jason Kwon, giám đốc chiến lược của OpenAI, phủ nhận cáo buộc của Musk và cho rằng vụ kiện có thể xuất phát từ việc Musk tiếc nuối không còn liên quan đến công ty.

- Musk, người đã rời OpenAI vào năm 2018 do mâu thuẫn với ban lãnh đạo, tỏ ra không hài lòng vì bị loại khỏi các cuộc thảo luận về AI, đặc biệt là khi dự án AI của riêng ông không đạt được sự chú ý như ChatGPT.

- Vụ kiện cũng nêu bật một mâu thuẫn trong cuộc thảo luận về AI hiện nay, khi OpenAI vừa khẳng định hệ thống AI của mình vô cùng mạnh mẽ, vừa cho rằng chúng chưa thể sánh kịp trí tuệ con người.

- Musk và các nhà sáng lập OpenAI lo ngại rằng một AGI quá mạnh mẽ không nên thuộc về một thực thể duy nhất và nếu xây dựng được AGI, cần phải thay đổi cấu trúc kiểm soát để tránh rủi ro.

- Musk cáo buộc OpenAI đã đạt được AGI với mô hình ngôn ngữ GPT-4 và công ty không được phép cấp phép cho Microsoft sử dụng công nghệ này.

- Vụ kiện đặt ra câu hỏi về việc ai có quyền quyết định khi nào một hệ thống được coi là AGI và liệu các công ty công nghệ có đang phóng đại hoặc giấu giếm khả năng thực sự của hệ thống của họ hay không.

📌 Vụ kiện của Elon Musk chống lại OpenAI không chỉ phản ánh một cuộc tranh cãi cá nhân mà còn làm sáng tỏ những thách thức và mâu thuẫn trong việc phát triển và kiểm soát công nghệ AI. Musk cáo buộc OpenAI đã đạt được AGI với mô hình ngôn ngữ GPT-4 và công ty không được phép cấp phép cho Microsoft sử dụng công nghệ này. Vụ kiện đặt ra câu hỏi về việc ai có quyền quyết định khi nào một hệ thống được coi là AGI và liệu các công ty công nghệ có đang phóng đại hoặc giấu giếm khả năng thực sự của hệ thống của họ hay không.

Citations:

[1]https://www.nytimes.com/2024/03/02/technology/elon-musk-openai-lawsuit-paradox.html

- Meta, dưới sự lãnh đạo của Mark Zuckerberg, đang hướng tới việc xây dựng trí tuệ nhân tạo tổng quát (AGI).

- Zuckerberg chưa xác định được thời gian cụ thể hoặc định nghĩa chính xác về AGI nhưng khẳng định mục tiêu quan trọng là sự rộng lớn của nó.

- FAIR, nhóm nghiên cứu AI của Meta, được chuyển về cùng một phần với đội ngũ phát triển sản phẩm AI tạo sinh, nhằm đưa tiến bộ AI đến người dùng.

- Cuộc chiến thu hút nhân tài AI đang diễn ra khốc liệt, với mức lương hấp dẫn có thể lên tới hơn 1 triệu đô la mỗi năm.

- Meta dự kiến sở hữu hơn 340,000 GPU Nvidia H100 vào cuối năm, với tổng lượng GPU lên đến gần 600,000 vào cuối năm 2024.

- Llama 2, mô hình ngôn ngữ lớn mới nhất của Meta, không tập trung vào khả năng phát triển mã nhưng vẫn quan trọng trong việc xây dựng AI thông minh hơn.

- Meta đang huấn luyện Llama 3 với khả năng tạo mã và tập trung vào kỹ năng lập kế hoạch và suy luận nâng cao.

- Zuckerberg tin tưởng vào việc mở cửa mã nguồn, trái với xu hướng ngày càng kín đáo của một số công ty khác như OpenAI.

📌 Meta đang tiến hành các bước nhằm phát triển AGI, với sự tích lũy lớn về tài năng và tài nguyên máy tính qua việc sở hữu số lượng GPU lớn. Với việc chuẩn bị sở hữu tới gần 600.000 GPU bởi cuối năm 2024 và phát triển mô hình Llama 3, Meta đang hướng tới việc trở thành người tiên phong trong lĩnh vực AI, đồng thời mở cửa triển vọng về AGI với tầm nhìn nguồn mở.

- OpenAI quyết định cung cấp 10 triệu đô la để giải quyết vấn đề kiểm soát AI siêu thông minh.

- Chương trình "Superalignment Fast Grants" nhằm ngăn chặn hệ thống AI tiên tiến trở nên nguy hiểm.

- OpenAI dự đoán sự xuất hiện của AI siêu thông minh trong vòng một thập kỷ.

- Các khoản tài trợ hướng tới nghiên cứu kỹ thuật đảm bảo kiểm soát an toàn và đạo đức của hệ thống AI.

- OpenAI cũng cung cấp học bổng "OpenAI Superalignment Fellowship" trị giá 150,000 đô la cho sinh viên sau đại học.

- Công ty đã xác định bảy thực hành chính để đảm bảo an toàn và trách nhiệm của hệ thống AI.

- Các khoản tài trợ từ 10,000 đến 100,000 đô la dành riêng cho nghiên cứu về AI siêu thông minh.

- Hệ thống AI "agentic" có khả năng thực hiện nhiều hành động một cách tự động và đáng tin cậy.

- OpenAI nhấn mạnh sự cần thiết của việc đảm bảo an toàn cho hệ thống AI "agentic", cũng như tính minh bạch trong quá trình suy nghĩ nội tại của chúng.

- CEO của OpenAI, Sam Altman, ám chỉ sự phát triển của mô hình GPT-5 có thể chứa yếu tố của AI siêu thông minh.

Kết luận: OpenAI, với việc cung cấp 10 triệu đô la cho các dự án nghiên cứu AI siêu thông minh, đang tiên phong trong việc định hình tương lai của trí tuệ nhân tạo. Qua việc tài trợ cho nghiên cứu và học bổng, OpenAI thể hiện cam kết trong việc phát triển AI một cách an toàn và có trách nhiệm. Sự thành công của những nỗ lực nghiên cứu này sẽ quyết định cách thức xã hội đối mặt với sự xuất hiện của AI siêu thông minh trong những năm tới.

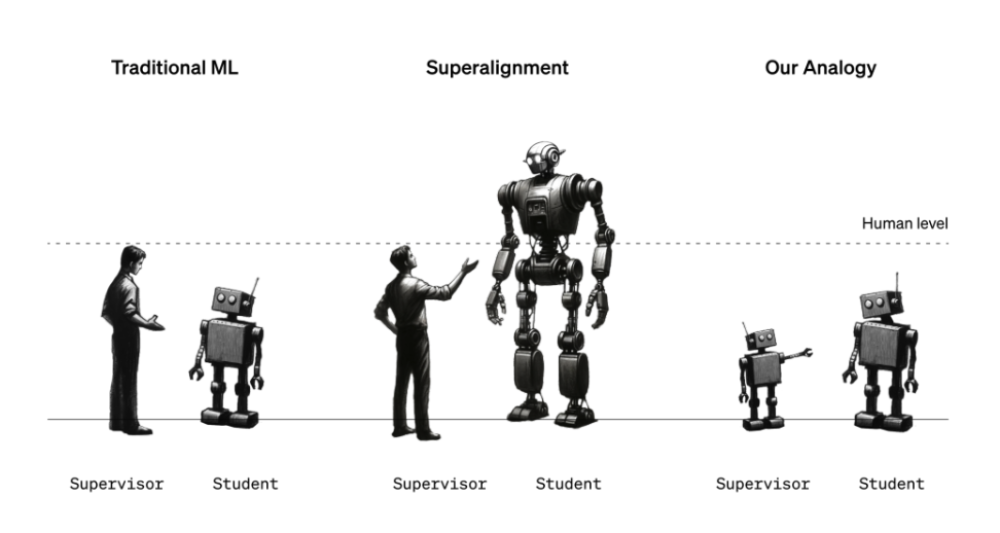

- OpenAI dự đoán sự xuất hiện của AI siêu cấp và đang phát triển công cụ để kiểm soát.

- Đội Superalignment của OpenAI, dẫn đầu bởi đồng sáng lập và giám đốc khoa học Ilya Sutskever, tập trung vào việc điều chỉnh AI siêu cấp.

- Đội ngũ đã giới thiệu công trình mới tại hội nghị học máy NeurIPS ở New Orleans.

- Công trình bao gồm phát triển framework để điều hướng và kiểm soát AI siêu thông minh, vượt xa trí tuệ con người.

- Sử dụng mô hình AI đơn giản (như GPT-2) để hướng dẫn mô hình phức tạp hơn (như GPT-4) theo hướng mong muốn.

- OpenAI cũng chuẩn bị ra mắt chương trình cấp kinh phí 10 triệu đô la cho nghiên cứu về superalignment.

OpenAI nhận thức rõ về tốc độ phát triển nhanh chóng của AI và tiềm năng của nó trong việc vượt qua trí tuệ con người. Điều này thúc đẩy việc tạo ra các công cụ và framework kiểm soát để đảm bảo rằng các hệ thống AI tương lai sẽ hành xử theo ý muốn của con người. Đồng thời, OpenAI cũng mở rộng cơ hội cho cộng đồng nghiên cứu với chương trình tài trợ lớn, nhằm tạo điều kiện cho sự phát triển trong lĩnh vực này.

- AGI, hay trí tuệ nhân tạo tổng quát, là khái niệm máy móc có khả năng hiểu và lý luận như con người.

- AI hiện tại phụ thuộc vào dữ liệu đào tạo và gặp khó khi đối mặt với tình huống mới.

- AGI không giới hạn bởi kỹ năng cụ thể, tự học hỏi và giải quyết vấn đề mới một cách logic.

- AI có khả năng đặc biệt trong khi AGI đa nhiệm và tự cải thiện liên tục.

- AGI chưa tồn tại; AI như ChatGPT và Google Bard đã có.

- AGI có thể làm biến đổi ngành y, sinh học, kỹ thuật.

- Các nhà nghiên cứu AI dự đoán AGI có thể xuất hiện từ năm 2030 đến 2050.

- GPT-4 được Microsoft nhận định có "tia sáng của AGI" với hiệu suất gần người.

- OpenAI có thể đã phát hiện breakthrough liên quan AGI, theo tin đồn chưa được xác minh từ Reuters.

Trí tuệ nhân tạo tổng quát (AGI) đang được nghiên cứu và phát triển, với mong muốn tạo ra những hệ thống máy móc có khả năng hiểu biết và lý luận tương đương hoặc vượt trội so với con người. AI hiện tại vẫn còn hạn chế trong việc áp dụng kiến thức trong các tình huống hoàn toàn mới mẻ, trong khi AGI sẽ không bị giới hạn bởi những kỹ năng cố định và có thể tự cải thiện không ngừng. Dự đoán thời gian xuất hiện của AGI, theo các nhà nghiên cứu, có thể sẽ là từ năm 2030 đến 2050. Mặc dù còn nhiều thách thức và lo ngại về đạo đức cũng như an toàn, tiềm năng của AGI trong việc cải tiến các lĩnh vực khoa học và kỹ thuật là không thể phủ nhận.

Follow Us

Tin phổ biến