Logic-of-Thought: Tăng cường khả năng suy luận logic cho LLM thông qua bổ sung logic mệnh đề

• Logic-of-Thought (LoT) là một phương pháp gợi ý mới nhằm cải thiện khả năng suy luận logic của các mô hình ngôn ngữ lớn (LLM).

• Mặc dù LLM đã đạt được nhiều tiến bộ trong xử lý ngôn ngữ tự nhiên, chúng vẫn gặp khó khăn với toán học và suy luận logic phức tạp.

• Các phương pháp hiện có như Chain-of-Thought (CoT) và các biến thể của nó đã cải thiện khả năng suy luận, nhưng vẫn tồn tại vấn đề về suy luận không trung thực.

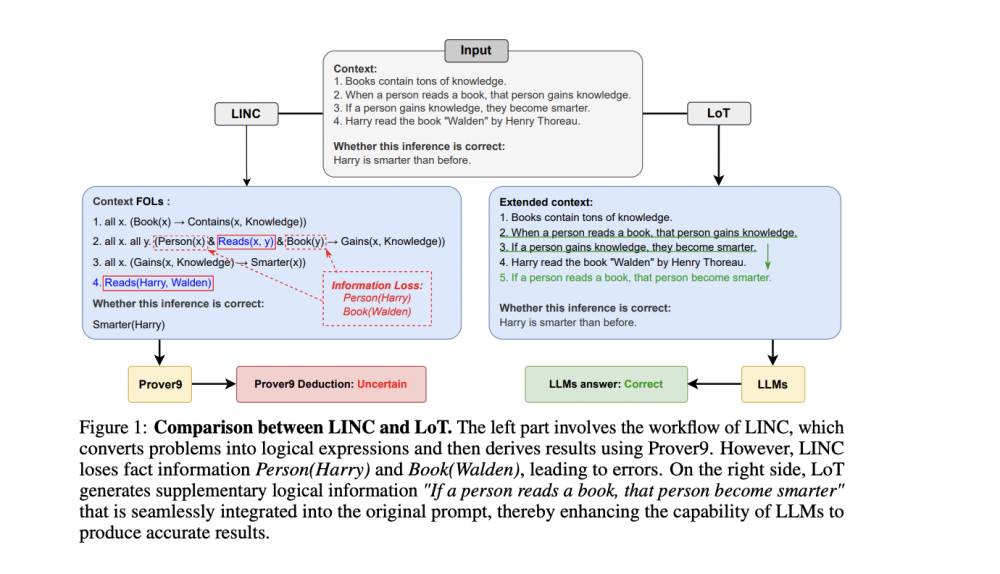

• LoT giải quyết vấn đề mất thông tin trong các phương pháp kết hợp biểu tượng-thần kinh hiện có.

• Phương pháp này trích xuất mệnh đề và biểu thức logic từ ngữ cảnh đầu vào, mở rộng chúng bằng luật suy luận logic, và chuyển đổi lại thành ngôn ngữ tự nhiên.

• Mô tả logic mở rộng được thêm vào gợi ý đầu vào ban đầu, hướng dẫn quá trình suy luận của LLM.

• LoT bao gồm 3 giai đoạn chính: Trích xuất Logic, Mở rộng Logic và Dịch Logic.

• Phương pháp này tương thích với các kỹ thuật gợi ý hiện có như Chain-of-Thought, Self-Consistency và Tree-of-Thoughts.

• Thử nghiệm trên 5 bộ dữ liệu suy luận logic cho thấy LoT cải thiện đáng kể hiệu suất của các phương pháp gợi ý khác nhau.

• LoT+CoT-SC(5) vượt trội so với các phương pháp khác, với LoT+SC đạt độ chính xác cao nhất trên bộ dữ liệu FOLIO với GPT-4.

• LoT cải thiện các phương pháp cơ sở trong 35/40 so sánh, chứng tỏ khả năng tích hợp và hiệu quả của nó.

• Một số hạn chế được quan sát thấy trong bộ dữ liệu RuleTaker và ProofWriter với GPT-4, do vấn đề trích xuất thông tin.

• Hiệu suất độc lập của LoT tương đương hoặc vượt trội so với CoT, cho thấy khả năng suy luận logic mạnh mẽ.

• Công việc trong tương lai sẽ tập trung vào khám phá thêm các mối quan hệ logic và luật suy luận, cũng như hỗ trợ nhiều phương pháp gợi ý hơn.

📌 Logic-of-Thought là phương pháp đột phá cải thiện suy luận logic của LLM bằng cách bổ sung logic mệnh đề. Thử nghiệm trên 5 bộ dữ liệu cho thấy LoT tăng hiệu suất đáng kể, với LoT+CoT-SC(5) vượt trội nhất. Phương pháp này hứa hẹn nâng cao khả năng suy luận của AI tạo sinh trong tương lai.

https://www.marktechpost.com/2024/10/02/logic-of-thought-enhancing-logical-reasoning-in-large-language-models-through-propositional-logic-augmentation/

Thảo luận

Follow Us

Tin phổ biến