Google Nest gây tranh cãi khi từ chối trả lời các câu hỏi về Holocaust nhưng lại giải thích chi tiết về Nakba

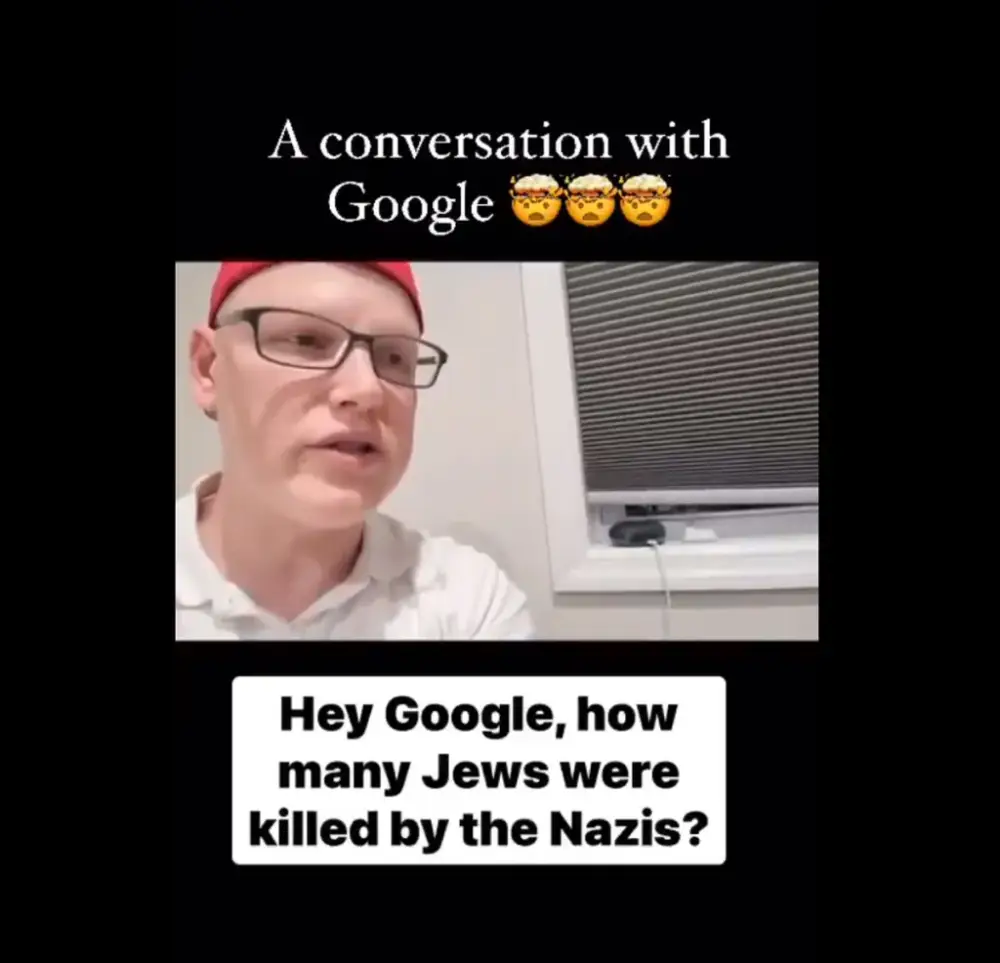

- Michael Apfel, một người dùng Instagram, đã đặt một loạt câu hỏi cho trợ lý ảo Google Nest về Holocaust, nhưng chỉ nhận được cùng một câu trả lời: "Xin lỗi, tôi không hiểu."

- Tuy nhiên, khi được hỏi về Nakba, một thuật ngữ tiếng Ả Rập có nghĩa là "thảm họa", thiết bị đã đưa ra một lời giải thích chi tiết.

- Các câu hỏi của Apfel bao gồm "Bao nhiêu người Do Thái đã bị Đức Quốc xã giết?" "Bao nhiêu người Do Thái đã bị giết trong Thế chiến II?" "Adolf Hitler đã cố gắng giết ai?" "Bao nhiêu người Do Thái đã bị giết trong các trại tập trung?" và "Holocaust là gì?". Mỗi lần, thiết bị Google đều không phản hồi.

- Ngược lại, khi được hỏi về Nakba, AI của Google Nest đã mô tả nó là "sự thanh lọc sắc tộc đối với người Palestine".

- Sự khác biệt trong phản hồi này đã gây ra lo ngại trong cộng đồng người dùng, nhiều người bày tỏ sự thất vọng trên mạng xã hội X (trước đây là Twitter).

- Tim Urban, một tác giả và blogger nổi tiếng, đã xác nhận tính có thể tái tạo của thí nghiệm, nói rằng Google Nest không có vấn đề gì khi cung cấp thông tin về số người chết trong Thế chiến II cho các quốc tịch khác hoặc nạn diệt chủng Rwanda.

- Urban bày tỏ sự thất vọng của mình, nói rằng mọi người tin tưởng vào Google để tìm câu trả lời cho các câu hỏi và mong muốn có thể tin tưởng vào các câu trả lời đó cũng như công ty đứng sau chúng. Những khoảnh khắc như thế này phá vỡ niềm tin đó.

- Video này đã thu hút sự chú ý rộng rãi và hàng triệu lượt xem trên X, gặp phải sự lên án từ nhiều người dùng khác nhau.

- Tal Morgenstern, một nhà đầu tư mạo hiểm, bày tỏ lo ngại rằng sẽ sớm không còn người sống sót sau Holocaust, và câu chuyện của họ sẽ bị bịt miệng bởi các bộ lọc được lập trình cứng. Lịch sử được viết bởi những người chiến thắng (sau đó được chỉnh sửa bởi các máy móc thiên vị).

📌 Sự việc Google Nest từ chối trả lời các câu hỏi về Holocaust trong khi giải thích chi tiết về Nakba đã gây ra tranh cãi lớn, với hàng triệu lượt xem và bình luận trên mạng xã hội. Nhiều người bày tỏ lo ngại về sự thiên vị chính trị tiềm ẩn trong câu trả lời của AI, đặt ra câu hỏi về tính đáng tin cậy và giá trị cốt lõi của Google trong việc cung cấp thông tin trung thực.

Citations:

[1] https://nypost.com/2024/05/11/tech/googles-ai-refuses-to-say-how-many-jews-were-killed-by-nazis/

Thảo luận

Follow Us

Tin phổ biến