Đẩy nhanh AI: Sự trỗi dậy của chip AI, GPU không đồng nghĩa với sự kết thúc của CPU

- Chip GPU của Nvidia chiếm hơn 80% thị trường chip AI. Chip Hopper ra mắt năm 2022 đã vượt trội trong mọi hạng mục từ phân loại hình ảnh đến nhận dạng giọng nói trên bài kiểm tra MLPerf. Chip Blackwell mới hứa hẹn nhanh hơn Hopper vài lần nhờ sức mạnh xử lý và khả năng giao tiếp giữa các chip tốt hơn.

- Sự phát triển của phần cứng đang cố gắng bắt kịp và hỗ trợ cuộc cách mạng AI. Nhiều tiến bộ trong AI 10 năm qua đến từ nguyên tắc đơn giản là càng lớn càng tốt. Các mô hình ngôn ngữ lớn như GPT-4 của OpenAI được huấn luyện trên bộ dữ liệu ngày càng lớn, đòi hỏi sức mạnh tính toán khổng lồ, gấp 100 lần so với mô hình tiền nhiệm.

- Các công ty như Meta xây dựng trung tâm dữ liệu dựa trên GPU của Nvidia. Google, IBM và nhiều công ty khác thiết kế chip AI riêng. Các nhà nghiên cứu đang thử nghiệm nhiều thiết kế chip, bao gồm cả tối ưu hóa cho thiết bị nhỏ. Khi AI vượt ra ngoài trung tâm điện toán đám mây và đi vào thiết bị di động, GPU không còn đủ.

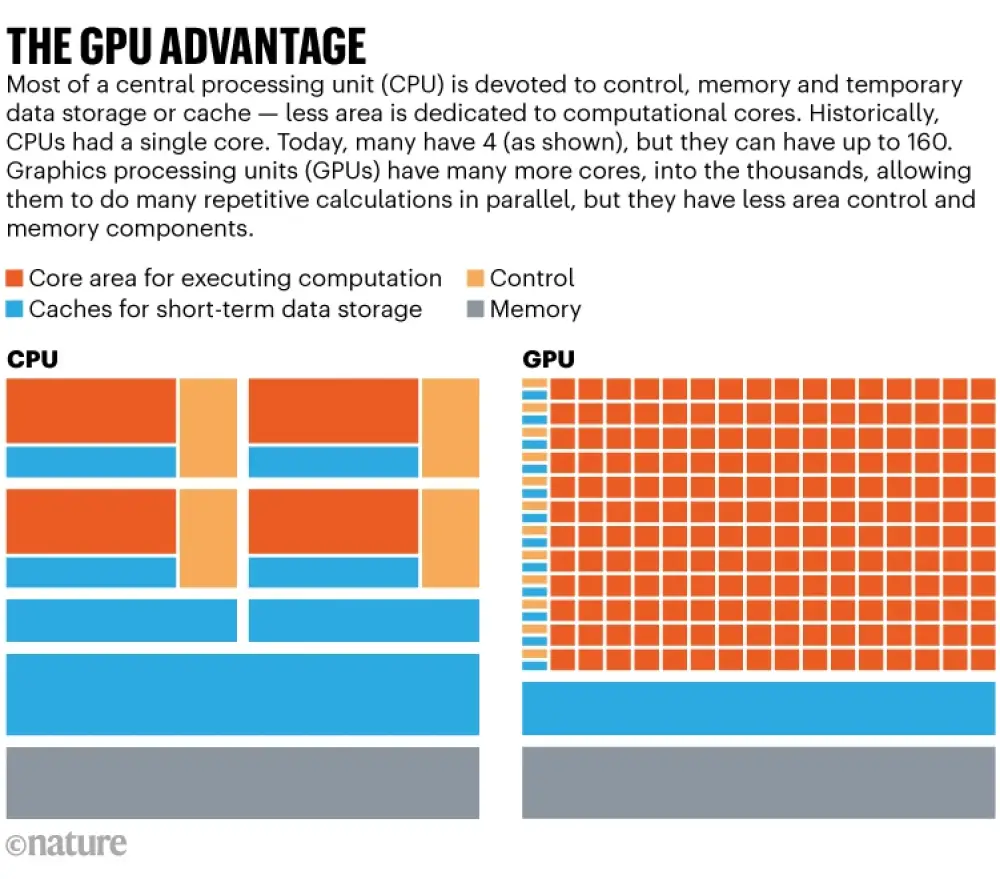

- Sự chuyển đổi từ CPU sang GPU đã thúc đẩy cuộc cách mạng deep learning. GPU xử lý nhiều lệnh song song nhanh hơn CPU tuần tự. Để huấn luyện mô hình GPT-3 với 175 tỷ tham số, các nhà nghiên cứu OpenAI phải chạy 1.024 GPU liên tục trong 1 tháng với chi phí hàng triệu USD. Tổng cộng, các GPU đó đã thực hiện 10^23 phép tính, nhanh hơn hàng trăm đến hàng nghìn lần so với CPU.

- Ngoài GPU, các loại chip AI khác bao gồm FPGA (lập trình được), TPU (đơn vị xử lý tensor của Google), chip AI di động. Chúng sử dụng các thủ thuật như tính toán song song, bộ nhớ truy cập nhanh, định dạng số rút gọn để tăng tốc. FPGA linh hoạt như hộp Lego, có thể lập trình mạch theo bất kỳ thiết kế nào. Chip AI di động giúp xử lý các tác vụ AI trên điện thoại mà không cần gửi dữ liệu lên đám mây.

- Tiêu thụ điện năng là mối quan tâm lớn. Huấn luyện GPT-3 ước tính tiêu tốn 1.300 MWh, bằng lượng điện hộ gia đình Anh dùng trong 1 năm. Ngay cả sau khi huấn luyện, sử dụng ứng dụng AI cũng tốn rất nhiều năng lượng. Mặc dù tiến bộ trong thiết kế chip có thể cải thiện hiệu quả, chi phí năng lượng của AI tiếp tục tăng hàng năm khi mô hình ngày càng lớn.

- Sự trỗi dậy của chip AI không đồng nghĩa với sự kết thúc của CPU. Ngược lại, ranh giới giữa các loại chip cơ bản đang mờ dần. CPU hiện đại tính toán song song tốt hơn trước, GPU đa năng hơn. Siêu máy tính mạnh nhất thế giới Frontier dựa trên sự kết hợp của CPU và GPU.

- Tương lai chip AI khó đoán, có thể bao gồm chip quang học dùng ánh sáng thay electron hay chip lượng tử. Giúp công chúng hiểu về phần cứng AI sẽ giúp họ nhận ra AI không phải phép thuật toàn năng. Tất cả chỉ là dây và electron, không thể thống trị thế giới. Các chuyên gia hy vọng phần cứng sẽ tiếp tục cải tiến, qua đó thúc đẩy các ứng dụng AI trong khoa học.

📌 Chip GPU và các loại chip chuyên biệt khác đang đẩy nhanh sự phát triển của AI với khả năng tính toán song song khổng lồ, đáp ứng nhu cầu ngày càng tăng. Tuy nhiên, việc huấn luyện các mô hình AI lớn như GPT-3, GPT-4 đòi hỏi nguồn tài nguyên tính toán và điện năng khổng lồ, với chi phí lên đến hàng triệu USD. Công nghệ chip AI đang phát triển nhanh chóng với nhiều hướng tiềm năng như chip quang học, lượng tử. Tương lai khó đoán định, nhưng việc giúp công chúng hiểu rõ hơn về phần cứng AI sẽ xóa bỏ quan niệm sai lầm cho rằng AI là phép thuật toàn năng.

https://www.nature.com/articles/d41586-024-01544-0

#NATURE

Thảo luận

Follow Us

Tin phổ biến